GPUx

GPUx offers ultra-fast serverless inference for AI models like Stable Diffusion and Whisper. Instantly deploy GPU-powered AI with 1-second cold starts, peer-to-peer sharing, and support for private models.

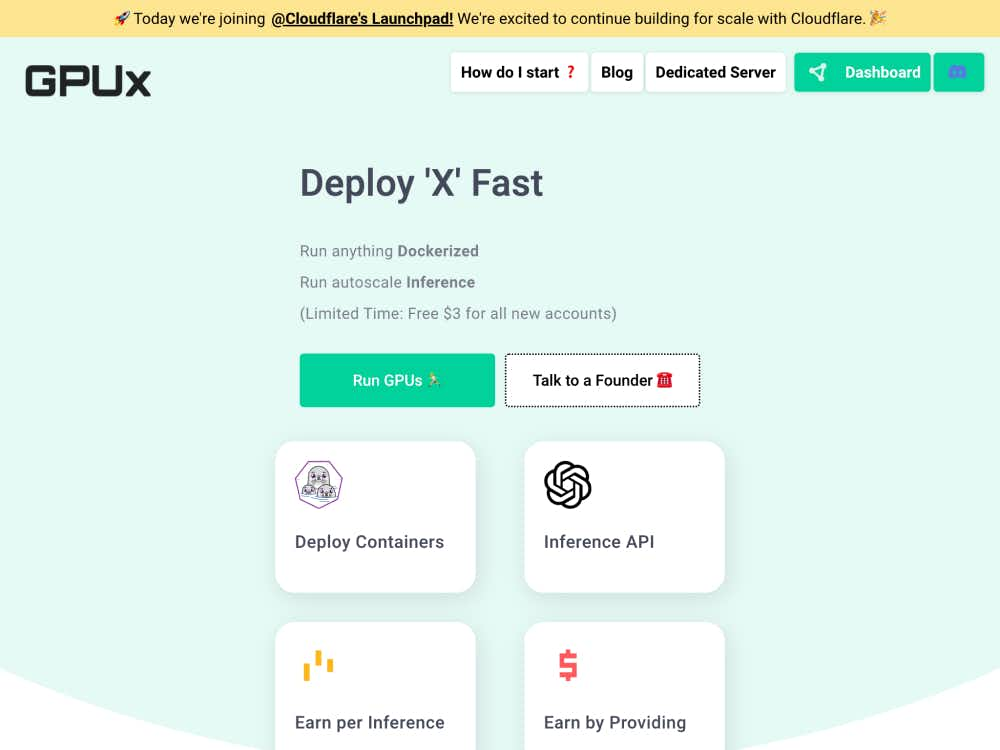

About GPUx

Deploy AI Models at Lightning Speed

GPUx is a serverless GPU inference platform built to simplify and accelerate AI deployment. Whether you're running Stable Diffusion, ESRGAN, Alpaca, or Whisper, GPUx enables you to launch models in seconds without managing infrastructure.

1-Second Cold Start for Instant AI

Time is critical when deploying AI applications. GPUx minimizes latency with 1s cold starts, ensuring your model is available almost instantly. Perfect for production environments or rapid prototyping, this speed makes a real difference for AI-first developers and teams.

How GPUx Works

Serverless GPU Inference

GPUx offers a serverless model that dynamically spins up GPU instances only when needed. This model reduces costs while giving you high-performance compute power for inference tasks. Models like Stable Diffusion XL or Whisper can be called via simple API requests with zero overhead.

Peer-to-Peer Model Sharing

Organizations can sell access to their private models through GPUx. This creates a marketplace for GPU inference and allows teams to monetize their machine learning workloads while maintaining control.

Key Features

Run Popular AI Models

GPUx supports a variety of widely-used machine learning models:

- StableDiffusionXL for high-quality image generation

- ESRGAN for image upscaling

- Whisper for speech-to-text transcription

- Alpaca for conversational AI

Volume Access and Read/Write Support

For models that require persistent data access, GPUx supports read/write volumes. This makes it ideal for complex pipelines, including those involving file-based I/O or model checkpoints.

Developer-Friendly Environment

GPUx provides CLI tools, GitHub integration, and example use cases via its blog to help developers get started quickly. With no need to manage GPUs, the platform handles orchestration so you can focus on model performance and delivery.

Use Cases

Fast Inference for Generative AI

Run text-to-image models in seconds using Stable Diffusion XL. Perfect for creative tools, visual prototyping, and image generation platforms.

Speech Transcription

Deploy Whisper models for real-time or batch audio transcription. Ideal for building speech-to-text applications without the cost or complexity of maintaining GPU servers.

Upscaling and Enhancement

Use ESRGAN for enhancing video or image quality. GPUx allows these enhancements to run smoothly in a serverless setup, making it suitable for media and production workflows.

Live Demos and Experimentation

Developers can rapidly iterate and deploy demos thanks to instant model access, enabling faster experimentation without provisioning GPU infrastructure.

Designed for Modern AI Teams

GPUx is trusted by a growing number of teams looking to deploy AI quickly, efficiently, and with full control. Whether you're a startup or an enterprise, the platform adapts to your needs—giving you scalability without complexity.